Inteligencia artificial

La coalición IA Ciudadana apela al Gobierno para crear un registro central y transparente de algoritmos

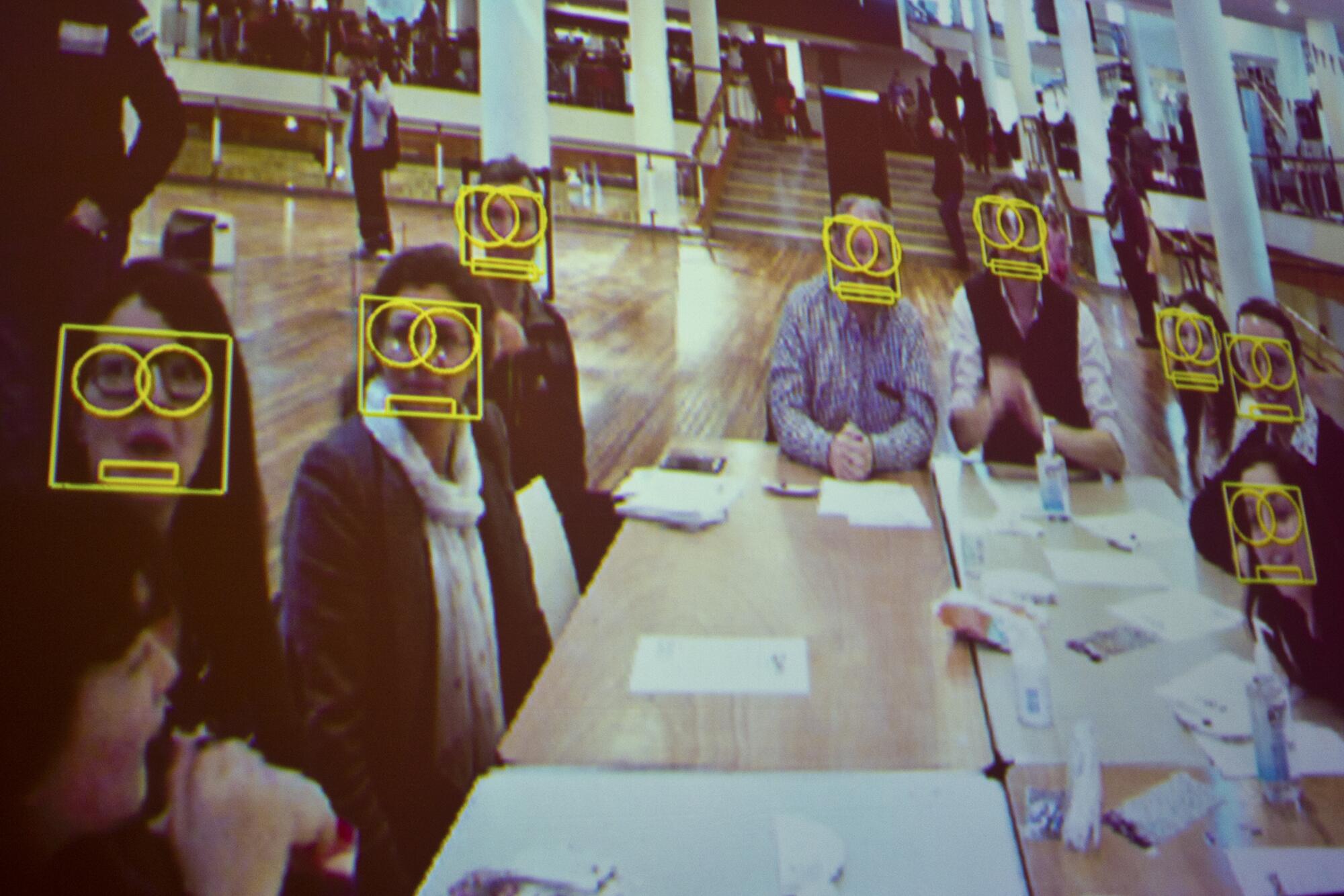

Cualquier servicio automatizado con inteligencia artificial que utilizamos en nuestro día a día tiene unos criterios y parámetros que valoran, de distinta manera, unas características, y dan por resultado una decisión. Son los tan nombrados algoritmos, más conocidos tal vez por cómo definen tendencias en las redes sociales, pero que se utilizan desde hace tiempo en diversos servicios. Los usa la administración pública, la Justicia, la Policía, la Banca, Hacienda, las aseguradoras, los servicios de empleo o incluso para la obtención de subsidios sociales, entre muchos otros. Es decir, una toma de decisiones automatizadas que impactan en nuestra vida diaria que, sin embargo, hasta hoy, no es posible supervisar sus implicaciones.

Todos aquellos sistemas automatizados que en principio se utilizan para “mejorar la eficiencia”, también discriminan, toman decisiones injustas y violan derechos fundamentales y todo sin saber exactamente cómo lo hacen. En la mayoría de los casos, estos sistemas operan sin control externo. Sucede en toda Europa y en España se puede ejemplificar en las 55 mujeres que fueron asesinadas después de que sus casos se consideraran de riesgo bajo por el sistema VioGen, que utiliza un sistema de evaluación automatizado, o los cientos de jóvenes afectados por “distorsiones” en el algoritmo con el que el Distrito Único Andaluz calcula las posiciones en las listas de entrada a los grados universitarios. Es aquí donde la tecnología se topa con los derechos de las personas y muchas veces, simplemente, pasa por encima de ellos, y sin saber cómo y bajo qué parámetros se hace.

La coalición IA Ciudadana, formada por 17 organizaciones que trabajan para defender los derechos humanos en el contexto de las tecnologías digitales, han publicado el informe “Cómo lograr una transparencia real con los registros de algoritmos”, que concluye con una apelación al Gobierno español: la creación de un Registro Central de Algoritmos. Para estas organizaciones el registro debe contener unas características fundamentales: ser obligatorio, participativo, es decir, producto de la colaboración con la sociedad civil, transparente y accesible, además de incluir todos los sistemas algorítmicos utilizados por la administración pública, que permitan saber qué algoritmos se usan, para qué y con qué efectos.

Algoritmos del día a día

Para ponerle cuerpo a las situaciones en las que las decisiones automatizadas juegan un papel definitivo en nuestras vidas, el estudio que presenta IA Ciudadana documenta algunos ejemplos, ya que en la mayoría de los casos no sabemos si los algoritmos que usan las administraciones públicas cumplen su objetivo. En el caso de la prevención de delitos por parte de la Policía, el hecho de automatizar los sistemas “puede desembocar en una hipervigilancia de determinadas zonas residenciales que concentran mayor porcentaje de personas extranjeras o pertenecientes a minorías étnicas, porque el algoritmo les otorgue mayor probabilidad de cometer un delito”.

El programa que concede o no el ingreso mínimo vital tampoco parece muy confiable según el informe, ya que no toma en cuenta datos como los de empadronamiento y composición familiar en su contexto. “Creemos que la ponderación de los datos y los posibles errores de evaluación pueden conllevar la denegación de solicitudes legítimas, menoscabando la efectividad del sistema de IMV. De nuevo, la falta de transparencia hace imposible demostrarlo”, subrayan en la investigación. Además, hay sospechas fundadas de discriminación racial, según ha denunciado Algorace

Fue el estudio de Éticas el que recogió que 55 mujeres asesinadas recibieron “una orden de protección que resultó ser insuficiente” por el sistema automático de Viogén

En uno de los casos más graves del uso de algoritmos está el no saber cómo funciona el sistema de seguimiento de la violencia de género (VioGén), que protege a las mujeres que lo necesitan, y al que ya se le han detectados fallos. Fue el estudio de Éticas el que recogió que 55 mujeres asesinadas recibieron “una orden de protección que resultó ser insuficiente” por dicho sistema, lo que puede deberse a que el sistema da automáticamente mayor protección a denunciantes con hijos que a aquellas que no los tenían. Los investigadores creen que el algoritmo no recoge suficiente información y que las predicciones podrían estar condicionadas por esa falta de datos. Esto, entienden, podría prevenirse si estos algoritmos se incluyeran en un registro nacional transparente, accesible y sometido a evaluaciones periódicas.

Sobre VioGén, Civio pidió información sobre el algoritmo en 2023, pero se le denegó con la excusa del peligro para la seguridad pública y para la prevención e investigación delitos. “Tampoco se han facilitado los casos de uso e información estadística relacionada con VioGén, solicitados en 2024, alegando que esa información no se podía extraer de la interfaz de la herramienta”, explica el informe. Si bien el gobierno anunció en enero pasado una revisión significativa de este sistema, “y sabemos que el algoritmo se ha actualizado hace apenas un mes, pero seguimos sin conocer cómo se ha hecho”, advierten.

El informe de la coalición ofrece también otros ejemplos en el sistema de justicia -sobre si es justo el cálculo de condenas o la autorización de permisos carcelarios y se si concede conforme a la ley-, en la Seguridad Social, que utiliza un algoritmo secreto para rastrear las bajas laborales y detectar el fraude, en Educación acerca de si es transparente la atribución de puntos en oposiciones o en el acceso a la universidad. Pero también en las administraciones públicas que llevan empleo o vivienda, así como en las entidades financieras que, por ejemplo, conceden crédito a según qué personas, sin que sepamos muy bien por qué. “¿Cómo podríamos saber qué ocurre en todos los casos? Con registros públicos de algoritmos”.

Europa y sus registros nacionales de algoritmos

El estudio realizó una investigación sobre los actuales registros activos en países europeos y cuentan 34 y al menos cinco en desarrollo. Solo Países Bajos, Reino Unido, Noruega y Francia cuentan con registros nacionales integrales. Destaca el registro holandés, con más de 600 algoritmos registrados, que incluye APIs en tiempo real para seguimiento de actualizaciones en sistemas automatizados, mientras que en otros países se limitan a documentos estáticos, en formato PDF, sin mecanismos de búsqueda. Esta es una prueba de la necesidad de transformar los registros de inventarios pasivos en herramientas dinámicas de control democrático.

IA Ciudadana señala que el Reglamento de la inteligencia artificial de la Unión Europea, en vigor desde 2024, es insuficiente porque “se obligará a incluir detalles técnicos básicos, pero no datos esenciales como el código fuente o los modelos de entrenamiento”. También la normativa muestra sus límites al excluir del registro obligatorio “los sistemas que considera de bajo riesgo y limita sectores críticos que van desde las fuerzas de seguridad y el control de fronteras hasta el sector financiero”, afirma Anabel Arias, responsable de derechos digitales de la federación de Consumidores y Usuarios CECU, y con ello limita el acceso público.

El informe recomienda que la base de datos central debe considerarse un punto de partida para que los Estados miembros de la UE desarrollen registros nacionales de algoritmos complementarios y más completos

Además, los proveedores de tecnología, es decir los fabricantes de estos sistemas, podrán autoexcluirse del registro si consideran que su producto no es de “alto riesgo”, sin apenas control externo posterior. Por tanto, la plataforma ciudadana propone ir más allá porque se trata de la protección de derechos fundamentales. Por ello, el informe recomienda que la base de datos central debe considerarse un punto de partida para que los Estados miembros de la UE desarrollen registros nacionales de algoritmos complementarios y más completos.

Desgraciadamente en España no se sabe cuántos algoritmos están en uso, en qué ámbitos operan y qué impacto tienen. Si bien el Gobierno español se ha planteado ir a la vanguardia en derechos digitales, sus propuestas no han recibido más que retrasos. En 2021, el Gobierno aprobó la Carta de derechos digitales siendo así el primer país en reconocer un conjunto de protecciones de la esfera digital, para la ciudadanía, como parte de las estrategias para reforzar la transparencia en los sectores público y privado. IA Ciudadana también ha constatado que aunque en la versión actualizada (2024) de la Estrategia Nacional de Inteligencia Artificial se menciona una “IA transparente, responsable e humanista”, esta no ha ido acompañada de acción alguna hasta hoy por parte de la Agencia Española de Supervisión de la Inteligencia Artificial (AESIA), el organismo competente, pero que aún no opera plenamente. Tampoco consta que se haya presentado el V Plan de Gobierno Abierto 2024-2028 que incluye la “Gobernanza Digital” como una área de reforma, agregan desde la coalición.

Sin un marco legal claro los riesgos del uso incontrolable de la IA se extienden también a las Comunidades Autónomas. “En Galicia, una IA influirá en los procesos de búsqueda pública de empleo sin que sepamos si se le ha entrenado para evitar discriminaciones por sexo o raza”, avisan desde la coalición. En este sentido, y como cita el informe, la únicas iniciativas a nivel autonómico que trabajan en una estrategia específica están en el País Valencià, con su Ley de Transparencia regional que obliga a publicar sistemas automatizados, con un registro en desarrollo junto con universidades; Catalunya donde se han publicado fichas técnicas detalladas de varios algoritmos, incluyendo cómo se ha entrenado el sistema, riesgos en términos de privacidad o discriminación, evaluaciones de sesgos y protocolos de revisión humana, y finalmente, en el País Vasco se están dando los primeros pasos. Sin embargo, el hecho de que no exista un marco estatal claro hace que estos esfuerzos sean aislados, por lo tanto, una seria y decisiva posición y acción del Gobierno central daría impulso a extenderse por otros territorios de manera coordinada.

Teniendo en cuenta este panorama, la oportunidad e importancia del estudio viene a propósito de la aprobación en el Consejo de Ministros del “Anteproyecto de Ley para la gobernanza y el buen uso de la inteligencia artificial”, anunciada por el gobierno la semana pasada. Para David Cabo, co-director de Civio, una de la entidades que forman parte de IA Ciudadana, este anuncio “es una gran oportunidad para crear este registro, que esperamos incluya a las organizaciones de la sociedad civil”, reiteran desde IA Ciudadana.

Recomendaciones para unos registros transparentes

El informe de IA Ciudadana ha llevado a pensar en avances y políticas para diseñar, implementar y evaluar los registros algorítmicos. Así señalan las siguientes recomendaciones dirigidas al Gobierno central. En primer lugar, que el registro de algoritmos tenga un carácter central y obligatorio que complemente “la base de datos del Reglamento de IA de la Unión Europea fomentando un registro más amplio y exigiendo información detallada a los proveedores e implementadores externos”, así como, “incluir algoritmos basados en reglas que pueden tener impactos significativos y garantizar el acceso público buscando un equilibrio entre transparencia y los riesgos”. Además deberá garantizar la total accesibilidad para diferentes públicos en el lenguaje, con filtros de búsqueda y facilitando documentación especializada.

En segundo lugar, para que el proceso sea participativo, proponen “crear un órgano consultivo a nivel ministerial en el que la sociedad civil esté formalmente representada y supervise el diseño y la creación del registro estatal”, y para la coordinación y seguimiento de las medidas de conectividad y digitalización de la economía y la sociedad.

La tercera recomendación va en el sentido de tener un marco legal específico para que el Registro de Algoritmos “funcione como un mecanismo de rendición de cuentas, manteniendo los principios de independencia e imparcialidad y garantizando la transparencia, la supervisión y la protección frente a influencias indebidas”.

Finalmente, la coalición de organizaciones que trabajan para defender los derechos humanos en el contexto de las tecnologías digitales, recomiendan al gobierno que establezca y mantenga una comunicación abierta y regular entre los organismos gubernamentales responsables de la política de digitalización e inteligencia artificial con la sociedad civil.

Más allá de las recomendaciones, las alianzas de la sociedad civil funcionan

Frente a los límites del Reglamento europeo y ante el impasse en la acción de gobierno, o incluso a la posible obstrucción directa por parte de las administraciones, IA Ciudadana reconoce que ha sido la sociedad civil organizada y algunos medios de comunicación, a través de investigaciones y denuncias ante los tribunales, quienes abogan más activamente por la transparencia algorítmica. Al poner a disposición el estudio y sus recomendaciones, la coalición quiere contribuir precisamente a que “académicos, periodistas y ONG puedan llevar a acabo su labor de fiscalización de los poderes públicos”, en cuestión de derechos y transparencia digitales.

Ha sido la sociedad civil organizada y algunos medios de comunicación, a través de investigaciones y denuncias ante los tribunales, quienes abogan más activamente por la transparencia algorítmica

En este sentido ya hay ejemplos como el del sistema de rastreo de bajas laborales por parte de la Seguridad Social que fue cuestionado por una investigación en la que se aliaron una ONG y un medio de comunicación, o la demande para que se aclare el programa BOSCO, que es el que se utiliza para conceder el bono social de la luz, y que actualmente está en el Tribunal Supremo.

Finalmente, IA Ciudadana, ve necesaria la participación del Parlamento español a través de la creación de una Comisión sobre transparencia algorítmica, abogar por una legislación específica, facilitar consultas públicas y comparecencias de expertos, a la vez que demande al Gobierno que informe, como mínimo, anualmente sobre este tema en el Congreso. “El trabajo duro empieza hoy. Esto no va de digitalización, va de derechos”, concluyen.

La Coalición IA Ciudadana la forman: Civio, Polítical Watch, Algorace, TAS, Eticas, LaFedeCat, Komons, Digital Fems, Institut de Drets Humans de Catalunya, Algorights, Iridia, Novact, CECU y Oxfam Intermón, y como observadoras, actúan Amnistía Internacional, Secretariado Gitano y X Net.

Inteligencia artificial

2024, el año en que nos hartamos de la Inteligencia Artificial

Inteligencia artificial

La oposición de autores y creadores fuerza a Urtasun a retirar el Real Decreto para regular la IA generativa

Inteligencia artificial

La Unión Europea abraza la ley del algoritmo más fuerte

Tecnología

“En las manos equivocadas, la IA puede hacer más daño que otras tecnologías previas”

Para comentar en este artículo tienes que estar registrado. Si ya tienes una cuenta, inicia sesión. Si todavía no la tienes, puedes crear una aquí en dos minutos sin coste ni números de cuenta.

Si eres socio/a puedes comentar sin moderación previa y valorar comentarios. El resto de comentarios son moderados y aprobados por la Redacción de El Salto. Para comentar sin moderación, ¡suscríbete!

.jpg?v=63947778655 2000w)

.jpg?v=63947778655 2000w)